Robots que sienten lo que tocan

El tacto es esencial en la relación de los humanos con su entorno. También entre robots y creadores. Un proyecto europeo liderado desde la Universidad de Bolonia enseña a las máquinas a distinguir lo que palpan para aplicar la fuerza adecuada

El investigador Roberto Meattini hace una demostración de cómo se utiliza el prototipo de mano robótica que están creando.

El famoso antropólogo Ashley Montagu escribió hace muchos años que “la comunicación que transmitimos con el tacto constituye el medio más poderoso de establecer relaciones humanas”.

Y aquí están, un día de primeros de mayo de 2023, un grupo de investigadores de la Universidad de Bolonia tratando de proporcionar el sentido del tacto a una máquina.

DOS TECNOLOGÍAS

Están usando dos tecnologías para darle a una mano robótica dos tipos distintos de sensibilidad: una, un poco más de trazo grueso, que cubrirá la mayor parte de la superficie de la palma, y otra que le ofrecerá una información mucho más rica y completa sobre la dureza, la aspereza o suavidad de los objetos, como la que nos transmiten las yemas de los dedos, y que el aparato tendrá precisamente ahí.

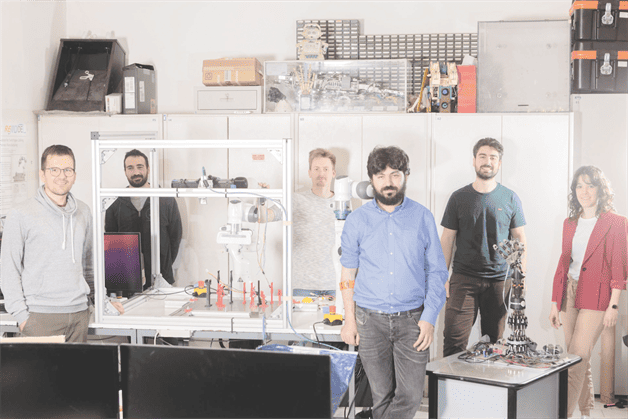

Hoy, en el Laboratorio de Robótica de la Facultad de Ingeniería, la investigadora predoctoral Alessandra Bernardini no solo se afana con infinita paciencia en explicar a los visitantes cómo funciona esto último —se colocan unos pequeños sensores semiesféricos, de un material maleable parecido a la goma, que envían al ordenador información sobre las propiedades del objeto que sujeta—, sino que está dispuesta a renunciar a dos de las fresas que ha traído para el almuerzo para ilustrar la demostración.

- A medida que la mano robótica va apretando el fruto rojo, los fototransmisores de los sensores traducen las perturbaciones de la goma en datos que se muestran en la pantalla en forma de gráficos de líneas que se juntan y se separan.

Junto a ella, Roberto Meattini, otro miembro del equipo, continúa con la demostración. Una vez que tiene bien sujeta a su muñeca derecha una estructura rectangular —en un extremo hay un hueco para meter la mano y en el contrario está acoplado el prototipo robótico—, comienza a encoger y a extender lentamente los dedos.

Lo que está haciendo, con la ayuda de Bernardini a los mandos del ordenador, es enseñar a la prótesis a leer los movimientos de los músculos del antebrazo que dirigen lo que hace su mano, para poder después repetirlos; una pulsera colocada un poco más abajo del codo es la encargada de recoger y transmitir esa información al robot a través de unos sensores inalámbricos.

Los dos ingenieros, junto a otra media docena de compañeros y liderados por el profesor Gianluca Palli, están dando apenas los primeros pasos del proyecto IntelliMan, formado por un consorcio de 13 universidades, empresas y centros de investigación de seis países europeos, con el objetivo de desarrollar un nuevo sistema de manipulación impulsado por inteligencia artificial que permita a los robots (ya sean prótesis como la mano que hemos visto o máquinas independientes) aprender tanto del entorno como de la interacción con las personas.

La Comisión Europea lo ha elegido entre los 42 primeros proyectos de inteligencia artificial y robótica lanzados dentro del programa Horizon Europe, el gran plan de investigación e innovación del continente.

Han sido seleccionados por su potencial para “mejorar la sociedad en que vivimos, abordando importantes desafíos tecnológicos”, según el documento que recopila las iniciativas. Entre las elegidas hay desde un gran centro que tratará de garantizar la seguridad en la investigación en inteligencia artificial hasta propuestas para la recuperación de agua, de reciclaje o de desarrollo de drones para apoyar a los trabajadores del campo y a empleados de mantenimiento de infraestructuras en lugares peligrosos.

En el caso IntelliMan, el profesor Palli explica en su despacho de la histórica ciudad italiana qué frutos tratarán de obtener de los 4,5 millones de euros que recibirán de la Comisión entre septiembre de 2022 y febrero de 2026.

En primer lugar, su objetivo es crear extremidades prostéticas con las que sus dueños sean capaces de abordar fácilmente sus actividades cotidianas, como sujetar un vaso o abrir una puerta o un cajón.

El siguiente paso será transmitir esas capacidades a una máquina independiente que se pueda convertir más pronto que tarde en un asistente robótico del hogar que ponga solito el lavavajillas o recoja la mesa después de comer.

La idea es que puedan interactuar con las personas, pero que nadie se imagine todavía charlando con ellos; se trata de enseñarles tareas nuevas —mostrándoles una vez cómo hacerlo, para que luego las repitan—, pero que, además, sean capaces de adaptar ese trabajo aprendido a un contexto cambiante: un obstáculo en el camino que antes no estaba ahí, un objeto más resbaladizo que el anterior.

Para eso necesitan el sentido de la vista —que se puede resolver con cámaras y sensores— y el más complicado del tacto, en el que están trabajando.

Pero no solo para dárselo a la máquina, sino también para que, en el caso de las prótesis, estas se lo hagan sentir también, de algún modo, a la persona que las utiliza: “Por ejemplo, estamos trabajando en transmitir la fuerza de agarre por medio de motores vibrotáctiles, que son pequeños motores que vibran a diferente amplitud de frecuencia [dependiendo de si esa fuerza es mayor o menor]”, explica Meattini, de vuelta en el laboratorio. “Es algo que ni siquiera las prótesis más avanzadas del mercado hacen todavía”, añade.

Los investigadores se mueven en un espacio en el que hay ordenadores y modernos prototipos de maquinaria puntera, pero también muchos cables, cartones, algún rollo de cinta aislante y un gran mueble metálico del que los ingenieros van sacando todo tipo de herramientas grandes, medianas y pequeñas.

Junto a ese mundo de tecnología ultramoderna, blanca y aséptica, de formas armónicas y redondeadas que preside nuestro imaginario colectivo, este laboratorio recuerda que los avances —al menos una parte y al menos en parte— siguen ocurriendo en lugares llenos de enchufes y de ángulos que pinchan, con objetos que hay que tocar para ensamblar y que hay que probar una y otra vez para encontrar la manera de que funcionen.

Unos lugares donde se entremezclan estudiantes, doctorandos, investigadores en ciernes con otros ya consagrados, que trabajan en proyectos simultáneos que confluyen y a veces se solapan. Donde, quizá precisamente por todo eso, resulta fundamental descomponer cada objetivo en tareas más pequeñas para hacerlos manejables e ir avanzando pasito a pasito, pero sobre peldaños firmes, hacia el resultado final.

Parte del equipo que opera desde Bolonia en el proyecto IntelliMan. A la derecha, la investigadora Alessandra Bernardini, que trabaja en los sensores que darán sentido del tacto a los robots. El tercero por la derecha es el profesor ayudante Roberto Meattini.